Краткий обзор: Международное многоцентровое исследование показало, что ни опытные радиологи, ни продвинутые мультимодальные большие языковые модели (БЯМ) не способны надёжно отличить рентгеновские снимки, сгенерированные искусственным интеллектом (так называемые «дипфейки»), от подлинных. В ходе исследования было протестировано 17 радиологов из шести стран, которым были представлены изображения, созданные ChatGPT и RoentGen. Даже когда участников предупредили о наличии синтетических изображений, точность радиологов в их выявлении составила в среднем всего 75%. Эти результаты выявляют серьёзную уязвимость в здравоохранении, которая может привести к мошенническим судебным процессам (например, сфабрикованным травмам) и киберугрозам, когда хакеры могут внедрять синтетические изображения в цифровые медицинские записи, вызывая хаос в клинической практике.

Ключевые факты:

- Уровень обмана: Когда радиологи не знали о наличии подделок, лишь 41% из них спонтанно заметили что-либо необычное в изображениях, сгенерированных ИИ.

- ИИ против ИИ: Даже GPT-4o – модель, использованная для создания дипфейков – не смогла точно распознать все свои собственные подделки, хотя она превзошла модели Google Gemini и Meta Llama.

- Признак «слишком совершенного»: Дипфейковые рентгеновские снимки часто выглядят неестественно симметричными; кости слишком гладкие, позвоночники «слишком прямые», а переломы выглядят «необычно чистыми».

- Опыт не защищает: Многолетний опыт радиологов (от 0 до 40 лет) не коррелировал с лучшей способностью к обнаружению, хотя специалисты по опорно-двигательному аппарату показали немного лучшие результаты, чем другие.

Результаты, опубликованные в журнале *Radiology*, подчёркивают потенциальные риски, связанные с рентгеновскими изображениями, созданными ИИ, а также необходимость в инструментах и обучении для защиты целостности медицинских изображений и подготовки медицинских работников к выявлению дипфейков.

Термин «дипфейк» относится к видео, фото, изображению или аудиозаписи, которые выглядят реальными, но были созданы или изменены с использованием ИИ.

Доктор Микаэль Торджман, ведущий автор исследования из Медицинской школы Икана на горе Синай, Нью-Йорк, отметил: «Наше исследование демонстрирует, что эти дипфейковые рентгеновские снимки достаточно реалистичны, чтобы обмануть радиологов – самых высококвалифицированных специалистов по медицинским изображениям, – даже когда они знали о присутствии изображений, сгенерированных ИИ». Он добавил, что это создаёт высокую уязвимость для мошеннических судебных процессов, например, если сфабрикованный перелом будет неотличим от настоящего. Также существует значительный риск кибербезопасности, если хакеры получат доступ к сети больницы и внедрят синтетические изображения, чтобы манипулировать диагнозами пациентов или вызвать широкомасштабный клинический хаос, подрывая фундаментальную надёжность цифровых медицинских записей.

В ретроспективном исследовании приняли участие семнадцать радиологов из 12 различных центров в шести странах (США, Франция, Германия, Турция, Великобритания и Объединённые Арабские Эмираты). Их профессиональный опыт варьировался от 0 до 40 лет. Половина из 264 рентгеновских снимков в исследовании были подлинными, а другая половина — сгенерированы ИИ. Радиологи оценивали два различных набора изображений, не пересекающихся между собой.

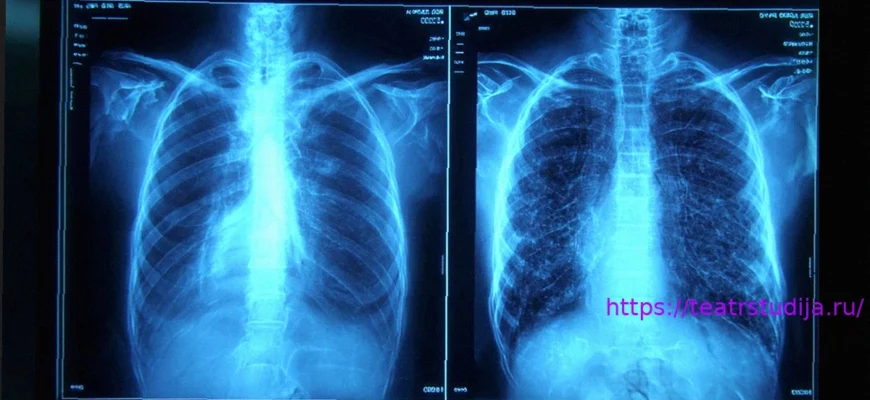

Первый набор данных включал реальные изображения и изображения, сгенерированные ChatGPT, различных анатомических областей. Второй набор данных состоял из рентгеновских снимков грудной клетки — половина подлинных, а другая половина создана RoentGen, генеративной моделью ИИ с открытым исходным кодом, разработанной исследователями Стэнфордской медицины.

Когда радиологи не знали об истинной цели исследования и после оценки технического качества каждого изображения ChatGPT их спрашивали, заметили ли они что-либо необычное, лишь 41% спонтанно идентифицировали изображения, сгенерированные ИИ. После того как участников проинформировали о наличии синтетических изображений, средняя точность радиологов в дифференциации реальных и синтетических рентгеновских снимков составила 75%.

Индивидуальная производительность радиологов в точном обнаружении изображений, сгенерированных ChatGPT, варьировалась от 58% до 92%. Аналогичным образом, точность четырёх мультимодальных БЯМ — GPT-4o (OpenAI), GPT-5 (OpenAI), Gemini 2.5 Pro (Google) и Llama 4 Maverick (Meta) — варьировалась от 57% до 85%. Даже ChatGPT-4o, модель, использованная для создания дипфейков, не смогла точно обнаружить все из них, хотя она выявила большинство из них со значительным отрывом по сравнению с БЯМ Google и Meta.

Точность радиологов в обнаружении синтетических рентгеновских снимков грудной клетки, созданных RoentGen, варьировалась от 62% до 78%, а производительность моделей БЯМ — от 52% до 89%.

Не было обнаружено корреляции между многолетним опытом радиолога и его точностью в обнаружении синтетических рентгеновских изображений. Однако радиологи-специалисты по опорно-двигательному аппарату продемонстрировали значительно более высокую точность, чем другие подспециалисты в радиологии.

Исследование выявило общие особенности синтетических рентгеновских снимков.

«Дипфейковые медицинские изображения часто выглядят слишком идеально», — сказал доктор Торджман. «Кости чрезмерно гладкие, позвоночники неестественно прямые, лёгкие слишком симметричные, рисунок кровеносных сосудов чрезмерно однородный, а переломы выглядят необычайно чистыми и последовательными, часто ограниченными одной стороной кости».

Рекомендуемые решения для чёткого различения реальных и поддельных изображений и предотвращения подделок включают внедрение передовых цифровых мер безопасности, таких как невидимые водяные знаки, встраивающие данные о принадлежности или идентификации непосредственно в изображения, и автоматическое прикрепление криптографических подписей, связанных с технологом, в момент получения изображений.

«Мы, возможно, видим только верхушку айсберга», — заявил доктор Торджман. «Следующим логическим шагом в этой эволюции является генерация ИИ синтетических 3D-изображений, таких как КТ и МРТ. Сейчас крайне важно создать образовательные наборы данных и инструменты для обнаружения».

Авторы исследования опубликовали тщательно отобранный набор данных дипфейков с интерактивными тестами для образовательных целей.

Ответы на ключевые вопросы:

- В: Зачем кому-то создавать «поддельные» рентгеновские снимки?

- О: Риски огромны. Их можно использовать для страхового мошенничества (фальсификация сломанной кости для получения компенсации) или, что более опасно, хакерами для манипулирования диагнозом пациента, что потенциально может привести к ненужным операциям или отказу в лечении.

- В: Если радиолог не может отличить подделку, имеет ли это значение?

- О: Да, потому что поддельное изображение не соответствует реальному телу пациента. Если ИИ «галлюцинирует» чистые лёгкие у пациента с пневмонией, пациент не получит необходимой для спасения жизни помощи.

- В: Как больницы могут защититься от этих дипфейков?

- О: Исследователи призывают к использованию «цифровых водяных знаков» и криптографических подписей, которые прикрепляются к изображению в тот момент, когда техник его делает, гарантируя, что файл не был изменён ИИ.